Suite au tweet de l’ami Walid, je pensais lui passer un petit skype pour lui souhaiter la bonne année et lui dire comment j’ai fait mais vu que vous êtes nombreux à poser la question, je vais vous partager ce que j’ai fait.

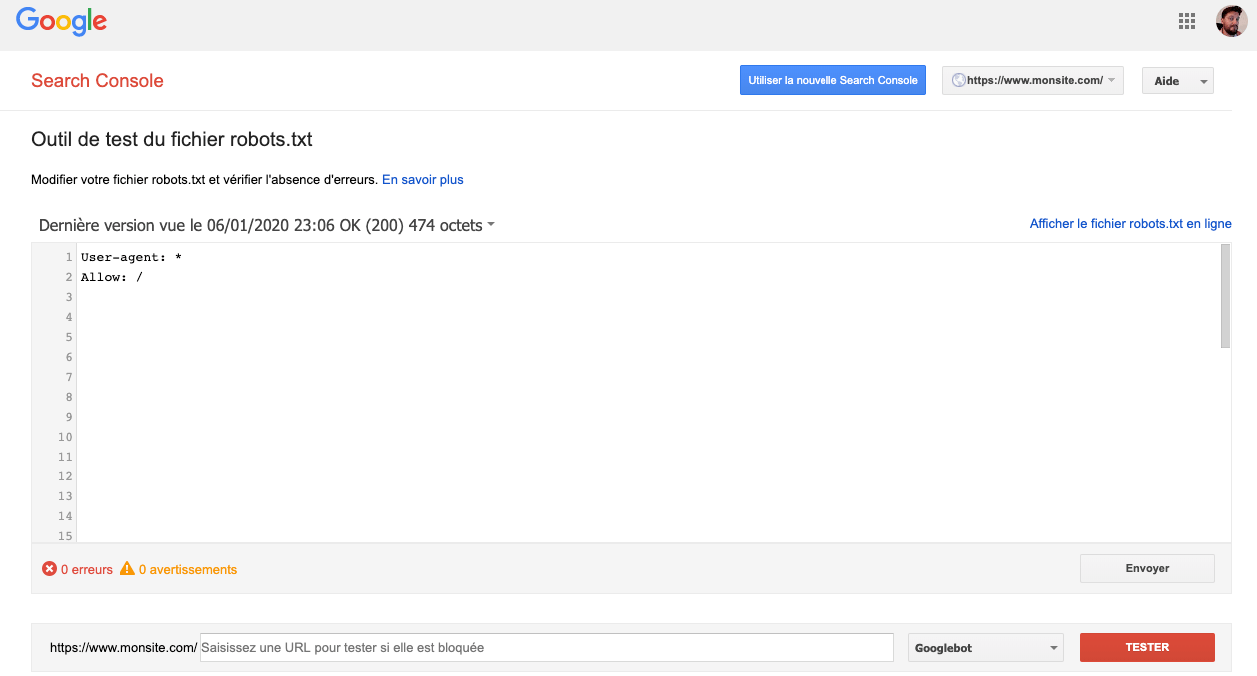

Indéxer un site malgré que la search console de Google retourne bloqué par le robots.txt